Microsoft mejora sus traducciones de IA con Z-Code – TechCrunch

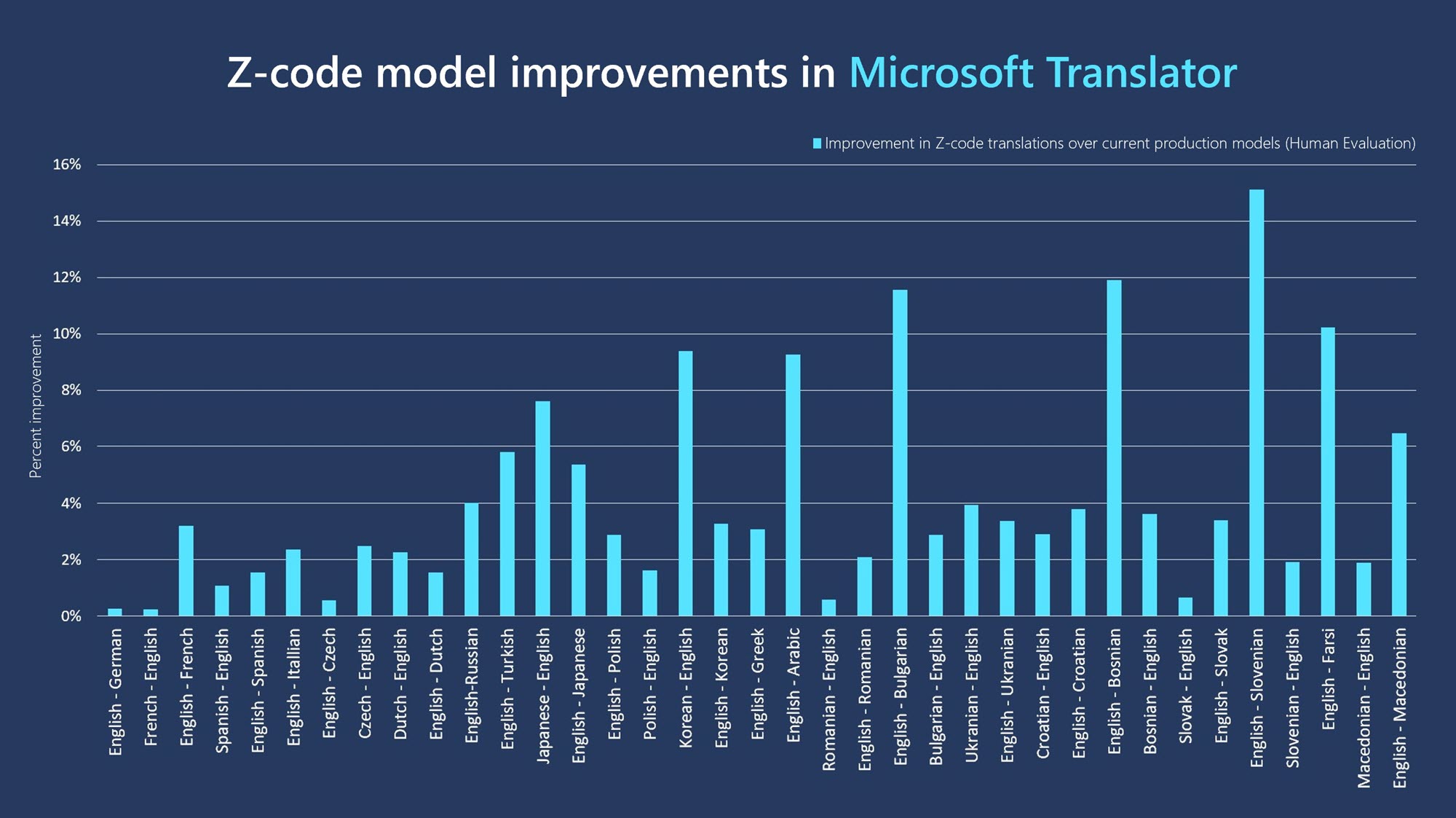

microsoft hoy anuncio una actualización de sus servicios de traducción que, gracias a las nuevas técnicas de aprendizaje automático, promete traducciones muy mejoradas entre una gran cantidad de pares de idiomas. Basado en su código Z del proyecto, que utiliza un enfoque de «combinación de expertos de reserva», estos nuevos modelos ahora suelen obtener una puntuación entre un 3 % y un 15 % mejor que los modelos anteriores de la empresa en revisiones ciegas. Z-Code es parte de la iniciativa XYZ-Code más grande de Microsoft, que tiene como objetivo combinar modelos de texto, visión y audio en varios idiomas para crear sistemas de IA más potentes y útiles.

La “mezcla experta” no es una técnica completamente nueva, pero es particularmente útil en el contexto de la traducción. En esencia, el sistema esencialmente divide las tareas en múltiples subtareas y luego las delega a modelos más pequeños y especializados llamados «expertos». Luego, el modelo decide qué tarea delegar a qué experto, según sus propias predicciones. Muy simplificado, puede considerarlo como un modelo que incluye varios modelos más especializados.

Una nueva clase de modelos Z-Code Mixture of Experts mejora el rendimiento de Traductor, un servicio cognitivo de Microsoft Azure. Créditos de la imagen: microsoft

«Con Z-Code, realmente estamos logrando un progreso increíble al aprovechar tanto el aprendizaje por transferencia como el aprendizaje multitarea a partir de datos monolingües y multilingües para crear un modelo de lenguaje de última generación que creemos que ofrece la mejor combinación de calidad, rendimiento y eficiencia que podemos ofrecer a nuestros clientes”, dijo Xuedong Huang, Microsoft Technical Fellow y CTO de Azure AI.

El resultado es un nuevo sistema que ahora puede, por ejemplo, traducir directamente entre 10 idiomas, eliminando la necesidad de múltiples sistemas. Microsoft también comenzó recientemente a usar modelos Z-Code para mejorar otras características de sus sistemas de inteligencia artificial, incluido el reconocimiento de entidades, el resumen de texto, la clasificación de texto personalizado y la extracción de frases clave. Esta es la primera vez que utiliza este enfoque para un servicio de traducción.

Tradicionalmente, los modelos de traducción son extremadamente grandes, lo que dificulta su integración en un entorno de producción. Sin embargo, el equipo de Microsoft optó por un enfoque «disperso», que solo activa una pequeña cantidad de parámetros del modelo por tarea en lugar de todo el sistema. «Eso los hace mucho más rentables para operar, de la misma manera que es más barato y más eficiente calentar su hogar solo en invierno durante las horas del día en que lo necesita y en los espacios que usa regularmente, en lugar de mantener un horno funcionando a toda velocidad todo el tiempo”, explica el equipo en el anuncio de hoy.

«Jugador orgulloso. Gurú del café. Alcoholico galardonado. Entusiasta de la cerveza. Estudiante. Aficionado a los zombis. Lector. Especialista en música. Aficionado a la comida».